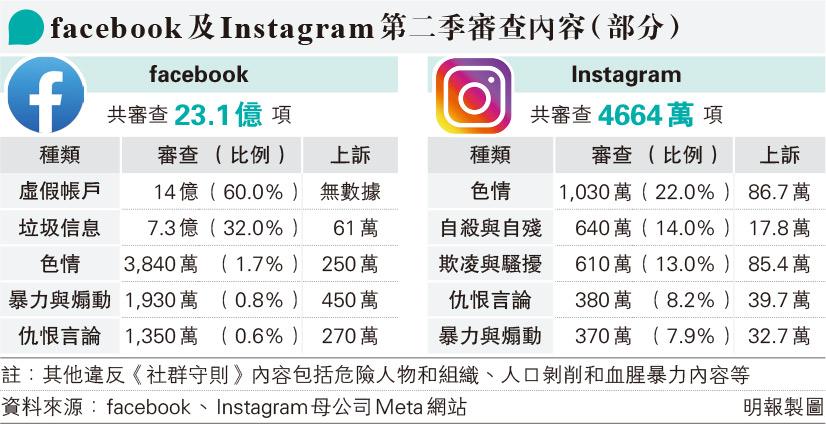

fb次季審查帖文23億條 Meta:關鍵詞非唯一標準

【明報專訊】不少網民常投訴社交網站內容被刪。facebook和Instagram母公司Meta數據顯示,今年第二季分別審查約23.1億條fb帖文,以及約4664萬條IG帖文,涉暴力與煽動、仇恨言論,及色情等內容。被問Meta會否審查特定關鍵詞,Meta亞太區內容政策主管Varun Reddy表示,關鍵詞不是唯一判斷信息有否違反《社群守則》的工具,又稱一旦偵測到或違反守則的關鍵詞會轉到部門職員判斷。

AI及人手偵測 全球1.5萬審查員

Meta昨以視像方式舉行亞太區內容政策記者會,Reddy表示,分別以可自我學習的電腦系統和人手偵測和決定用戶信息有否違反《社群守則》。用戶在社交平台發布信息時,須遵守約25至30項守則。Meta聘用逾1.5萬名審查員,在全球逾20個地點24小時工作,各人來自不同專業範疇,包括退役軍人和法律專家等,可審查逾50種語言。另外,Meta在全球邀請約20名專家學者組成監督委員會,就部分審查內容作具約束力的裁決,並因應公司政策提供建議。

Reddy以仇恨言論為例,稱部分字眼涉仇恨性質,但如看完整句子,用戶或在譴責發布仇恨言論者,內容就不違反守則。他稱守則適用全球facebook及Instagram用戶,沒就個別國家訂不同守則。他稱,守則由各地專家因應文化和語言差異而制定。

Reddy承認,公司不時收到各地政府要求某些用戶內容下架,公司會按程序處理,先確認提出要求的部門在當地是否獲認可或授權,然後判斷內容有否違反公司守則,一旦違反,不論投訴人身分,內容都會下架;如果帖文違反當地法律,公司會向各地分部諮詢法律和人權意見,再將是否下架的決定通知相關政府部門。

回應網民質疑動機 Meta:守則詳細公開

Meta產品政策和戰略副總裁Andy O'Connell補充,部分用戶有時質疑Meta審查動機和是否公平,惟公司網站已詳細和公開地列出守則;他稱即使公司將某些內容下架,平台亦會向用戶解釋原因,並給予機會上訴。